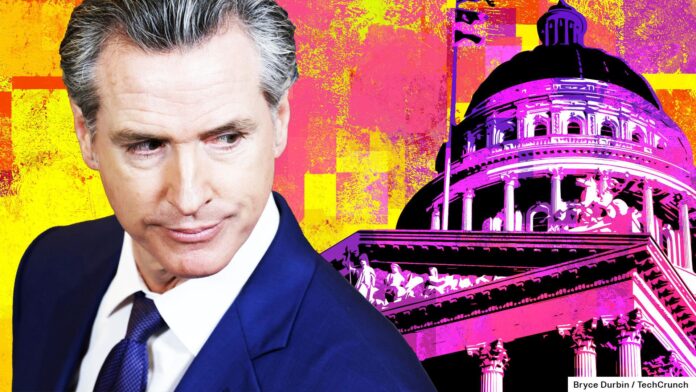

В Калифорнии разворачивается драма, которая может переписать правила игры в мире искусственного интеллекта. На столе у губернатора Гэвина Ньюсома лежит законопроект SB 1047 – своеобразный «дыхательный тест» для гигантов ИИ, способный либо запустить эру ответственного развития этой технологии, либо задушить ее в зародыше.

Представленный сенатором Скоттом Винером, SB 1047 – это не просто очередной нормативный акт. Это вызов индустрии, призыв к взвешенности и ответственности в эпоху стремительного развития ИИ. Законопроект нацелен на предотвращение катастроф, вызванных «гигантами» искусственного интеллекта, такими как массовые человеческие жертвы или кибератаки с ущербом свыше 500 миллионов долларов.

Будущее, а не Прошлое: Риски, которых Пока Нет, Но Могут Быть

Сегодня таких моделей ИИ, способных вызвать масштабные катастрофы, единицы. Кибератаки такого уровня тоже пока не зафиксированы. Однако SB 1047 смотрит в будущее, ставит вопрос о том, как предотвратить потенциальные угрозы, а не реагировать на уже случившееся.

Законопроект устанавливает принципиально новую парадигму ответственности: разработчики ИИ будут отвечать за вред, причиненный их творениями, подобно производителям оружия, несущим ответственность за массовые расстрелы. Генеральному прокурору Калифорнии предоставляется право подавать иски с требованием крупных штрафов против компаний, чьи технологии использовались в катастрофических ситуациях. В случае халатности суд может даже запретить деятельность компании, а защищенные модели должны иметь «аварийный выключатель» для немедленного отключения при признании их опасными.

Два Столпа: Оптимизм и Тревога

Сторонники и Оппоненты

SB 1047 разделил калифорнийскую технологическую сцену на два лагеря. С одной стороны, оптимисты видят в нем шанс на создание этичного и безопасного будущего ИИ.

- Винер: «Кремниевая долина нуждается в большей ответственности. Мы должны извлечь уроки из прошлых ошибок регулирования технологий».

- Илон Маск, София Веластеги (бывший директор Microsoft по ИИ) и Anthropic: выражают осторожный оптимизм, признавая необходимость управления ответственностью в сфере ИИ.

С другой стороны, индустрия искусственного интеллекта подняла тревогу, опасаясь за инновации и экономический рост.

- Andreessen Horowitz (a16z), OpenAI, крупные технологические компании и известные исследователи ИИ: призывают Ньюсома наложить вето, предупреждая о негативных последствиях для развития ИИ в Калифорнии.

- Торговая палата США: подчеркивает роль ИИ в экономическом росте страны и просит губернатора отклонить законопроект.

Два Пути: Калифорнийский Закон или Федеральный Подход?

Решение Ньюсома определит судьбу SB 1047 и, возможно, курс развития ИИ в США. Если он подпишет закон:

- 2025 год: отчеты о безопасности для моделей ИИ.

- 2026 год: создание Совета по передовым моделям, аудиты безопасности и право на судебные запреты в случае опасности.

- 2027 год: рекомендации Совета разработчикам по безопасному обучению и эксплуатации ИИ.

Если же вето будет наложено, федеральные регуляторы, скорее всего, возьмут инициативу в свои руки. OpenAI и Anthropic уже предложили сотрудничество с институтом безопасности ИИ, намекая на более мягкий федеральный подход, но медленный и требующий времени.

Калифорния стоит на перепутье. Будет ли SB 1047 катализатором взрывного роста ответственного ИИ или тормозом для инноваций? Ответ лежит в руках губернатора Ньюсома – его решение определит не только судьбу закона, но и вектор развития этой революционной технологии.